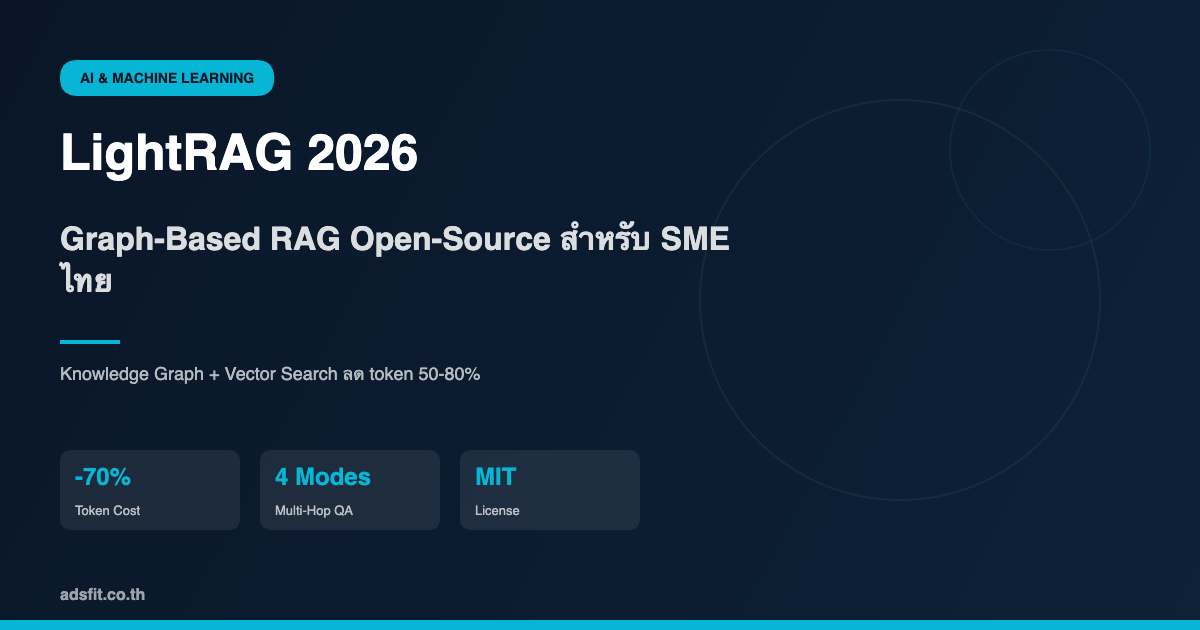

# LightRAG 2026: คู่มือ Graph-Based RAG Open-Source สำหรับ SME ไทย

ในยุคที่ทุกธุรกิจต้องการ AI Chatbot ที่ตอบคำถามจากเอกสารภายในได้แม่นยำ Retrieval-Augmented Generation (RAG) แบบ Vector Search ดั้งเดิมเริ่มไม่พอ เพราะมัน "ตอบเก่ง" เฉพาะคำถามตรง ๆ แต่จะแย่ทันทีเมื่อต้องเชื่อมโยงข้อมูลข้ามเอกสาร เช่น "พนักงานที่เข้ามาในปี 2024 และอยู่แผนกบัญชี มีใครบ้างและรายงานต่อใคร?"

ปัญหานี้คือสาเหตุที่ GraphRAG ของ Microsoft ดังเปรี้ยงปร้างในปี 2024 — ใช้ Knowledge Graph ดึงความสัมพันธ์ออกมา แต่ค่าใช้จ่าย token สูงมาก สำหรับ SME ไทย การ index 1,000 หน้าเอกสารอาจกินงบหลักหมื่นบาท และอัปเดตยาก

LightRAG คือคำตอบใหม่ปี 2025-2026 — open-source framework จาก HKU Data Intelligence Lab ที่ผสาน Knowledge Graph + Vector Search ด้วยสถาปัตยกรรมเบากว่า ลดค่า token ลง 50-80% และรองรับ incremental update โดยไม่ต้อง rebuild ทั้ง index ใหม่ บทความนี้จะพาคุณเข้าใจตั้งแต่หลักการ การ deploy ใช้งานจริง จนถึง use case ที่ ROI คุ้มทุนสำหรับ SME ไทย

LightRAG คืออะไร — และทำไมถึงต่างจาก RAG ทั่วไป

LightRAG คือ retrieval framework ที่สร้าง knowledge graph จากเอกสารโดยอัตโนมัติ พร้อมเก็บ vector embedding คู่ขนานกัน เมื่อมีคำถามเข้ามา ระบบจะใช้ทั้งสองแหล่งร่วมกัน (dual-level retrieval) แทนที่จะใช้ vector search อย่างเดียว

ความต่างหลัก ๆ จาก RAG รุ่นเก่า:

เปรียบเทียบ LightRAG vs GraphRAG vs Vector RAG

| คุณสมบัติ | Vector RAG | Microsoft GraphRAG | LightRAG |

|----------|-----------|-------------------|----------|

| ค่า indexing 1,000 หน้า | ~$5-10 | ~$200-500 | ~$30-80 |

| Multi-hop Question | ❌ อ่อน | ✅ ดีมาก | ✅ ดี |

| Incremental Update | ✅ ได้ | ❌ ต้อง rebuild | ✅ ได้ |

| Setup Complexity | ง่ายมาก | ซับซ้อน | ปานกลาง |

| Open-Source License | หลายตัว | MIT | MIT |

| รองรับภาษาไทย | ✅ (ขึ้นกับ embedder) | ✅ | ✅ |

สรุปง่าย ๆ: ถ้างบจำกัดและต้องการ multi-hop reasoning แบบประหยัด LightRAG ตอบโจทย์ที่สุดในปี 2026

สถาปัตยกรรมการทำงาน 3 เลเยอร์

LightRAG แบ่งการทำงานออกเป็น 3 ส่วนชัดเจน เหมาะกับการ deploy บน infrastructure SME ที่มีจำกัด:

ข้อดีของการแยกเลเยอร์คือคุณสลับ component ได้: ใช้ Ollama + Llama 3.3 บน on-premise สำหรับเอกสารลับ หรือใช้ OpenAI API สำหรับ workload ทั่วไป

How-to: Deploy LightRAG บน SME ใน 6 ขั้นตอน

ตัวอย่างการ deploy LightRAG บน VPS ขนาด 4 vCPU / 8 GB RAM ที่ SME ไทยใช้ทั่วไป:

โดยทั่วไป SME ไทยจะ deploy ครั้งแรกได้ภายใน 1-2 สัปดาห์ ถ้าทีมมีพื้นฐาน Python/DevOps

5 Use Case ที่ ROI คุ้มทุนภายใน 6 เดือน

LightRAG เหมาะกับงานที่มี "เอกสารปริมาณมาก + คำถามซับซ้อน" ตัวอย่าง use case ที่เห็นผลจริง:

หัวใจสำคัญคือเอกสารต้อง "มี structure" และ "มีความสัมพันธ์ระหว่าง entity" — ถ้าเป็น FAQ สั้น ๆ Vector RAG ก็พอแล้ว ไม่ต้องลงทุน LightRAG

ความเสี่ยงและข้อควรระวัง

LightRAG ไม่ใช่ silver bullet — สิ่งที่ต้องระวัง:

ที่ ADS FIT เราแนะนำให้ทำ PoC 2-4 สัปดาห์กับเอกสารจริง 1 หมวด ก่อนตัดสินใจ scale ทั้งองค์กร

สรุปและก้าวต่อไป

LightRAG คือก้าวกระโดดของ RAG ในปี 2026 — รวมจุดแข็งของ Vector Search (เร็ว, ถูก) กับ Knowledge Graph (เข้าใจความสัมพันธ์) ในแพ็กเกจเดียว เหมาะกับ SME ไทยที่ต้องการ AI Chatbot ฉลาดบนเอกสารภายใน โดยไม่ต้องเสียค่า indexing แพงเหมือน GraphRAG

Key Takeaway:

Call to Action: ถ้าธุรกิจคุณมีเอกสารภายในมากกว่า 200 หน้า และทีมยังตอบคำถามซ้ำ ๆ ทุกวัน — ถึงเวลาทำ PoC ระบบ AI Knowledge Assistant แล้ว ทีม ADS FIT พร้อมให้คำปรึกษาตั้งแต่ออกแบบสถาปัตยกรรม เลือก LLM ที่เหมาะกับงบ จนถึง deploy + monitoring ครบจบในที่เดียว

อ่านบทความที่เกี่ยวข้อง: [คู่มือ RAG Open-Source](/blog), [GraphRAG vs LightRAG](/blog), [Knowledge Graph สำหรับ SME](/blog) — หรือ [ติดต่อทีม ADS FIT](/#contact) เพื่อรับ consultation ฟรี